Responsible AI는 AI의 잠재적 위험이 불거지며 주목받은 개념으로, AI 시스템의 개발, 운영, 배포 과정의 윤리성, 투명성, 사용자 개인 정보와 사회적 가치에 대한 존중을 포함합니다. 지난해 10월 30일 바이든 정부가 AI 관련된 조치 중 가장 강력하다고 평가받는 일명 ‘AI 행정명령’을 발표하며 Responsible AI는 피할 수 없는 흐름이 되었습니다. 이에 PwC컨설팅은 행정명령의 세부 내용을 살펴보며 Responsible AI 시대에 대응하기 위한 방법을 제안합니다.

Responsible AI의 개념과 등장 배경

- 아마존의 채용 추천 AI의 성차별 논란, 유나이티드 헬스그룹의 치료 우선순위 결정 알고리즘의 인종차별 논란 등이 불거지며 AI 윤리 기준 마련의 필요성 대두

- Responsible AI는 AI가 인간의 가치와 복지에 부합하는 방식으로 사용되는 것을 목표로 함

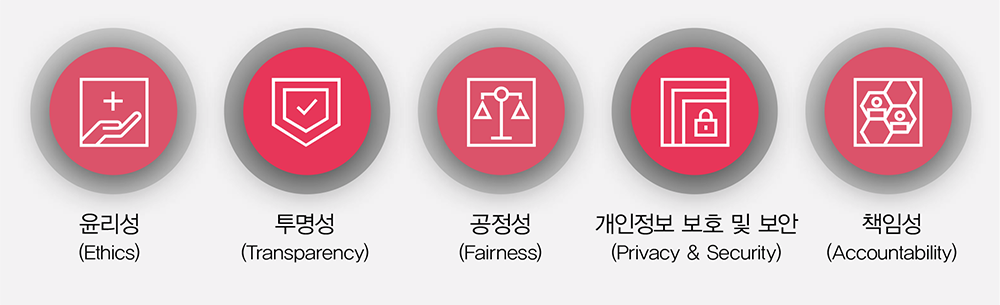

- Responsible AI의 주요 구성 요소

| 윤리성 | AI가 잠재적으로 미칠 영향과 운영 과정, 그리고 의사결정이 윤리적 지침에 부합 |

| 투명성 | 입력 데이터, 학습 방법, 의사결정 프로세스 및 결정을 이해관계자와 공유 |

| 공정성 | 차별적 결과를 초래할 수 있는 데이터 수집 및 알고리즘 모델의 편견 배제 |

| 개인정보 보호 및 보안 | AI 개발 과정에서 데이터 유출 및 공개의 방지 |

| 책임성 | AI에 기반한 의사결정 및 행동에 대한 책임 강조 |

바이든 행정부의 AI 행정명령

- ‘2022 AI 권리장전을 위한 청사진’에 기반한 행정명령으로, 인력, 핵심 기반시설, 국가 안보, 민주주의 등에 대한 AI 리스크 해소 및 AI를 통한 새로운 국가적 기회의 발굴 목표. 2021년 6월 채택된 EU의 ‘AI 법안’과 2022년 2월 발간된 한국의 자율 준수 가이드라인을 포함한 전 세계 정부가 취한 조치들 중 가장 강력

- Responsible AI를 위한 8가지 가이드

안전과 보안을 위한 기준

|

미국인들의 프라이버시 보호

|

형평성과 시민권 증진

|

소비자, 환자, 학생 보호

|

근로자 보호

|

혁신 및 경쟁의 촉진

|

미국 리더십의 해외 확장

|

정부의 책임 있고 효과적인 AI 활용 보장

|

Responsible AI 시대를 위한 제언

- Responsible AI를 위한 7가지 고려사항

| 행정명령이 조직에 미치는 영향 확인 | 연방 차원의 조치와 비즈니스 부문의 잠재적 교차점 파악 및 대응 계획 마련 |

| 규제 제정 과정 모니터링 및 의견 제시 | 행정명령 준수를 위해 유관 부서가 발표하는 구체적 지침 대비 및 의견 수렴 과정에의 적극적인 참여 |

| AI 기술의 리스크 평가 및 관리 | AI 리스크를 관리하고 보고할 수 있는 리스크 분류 체계와 기업 거버넌스 모델 개발, 관련 직원 역량 강화, 개인정보 보호 강화 기술 프레임워크를 포함하는 포괄적 프라이버시 프로그램의 도입 고려 |

| Trust-by-Design 기법의 AI 적용 | AI와 그 결과물의 신뢰를 입증하기 위한 요건의 정의와 그 효과성 입증, 관련 시스템과 데이터, 테스트 결과의 문서화 |

| AI 모델의 세분화 | 안보, 공중 보건 등 특수한 영역의 AI 모델과 그 외의 일반적인 영역의 AI 모델을 구분 |

| 위험 완화에 활용 | 소프트웨어의 취약점을 찾아 수정하거나 사이버 사고를 자동으로 감지하는 등 위험 완화에 AI 활용 |

| 투명성 강화 | 위험 평가, 시뮬레이션 결과 공유와 같은 의무 이행을 위한 프로세스 문서화, 외부 정보 공개 요구에 대응 |